Parceiros de ia: a busca por conexão na era digital e os riscos de um amor artificial

Marcelo Vivacqua

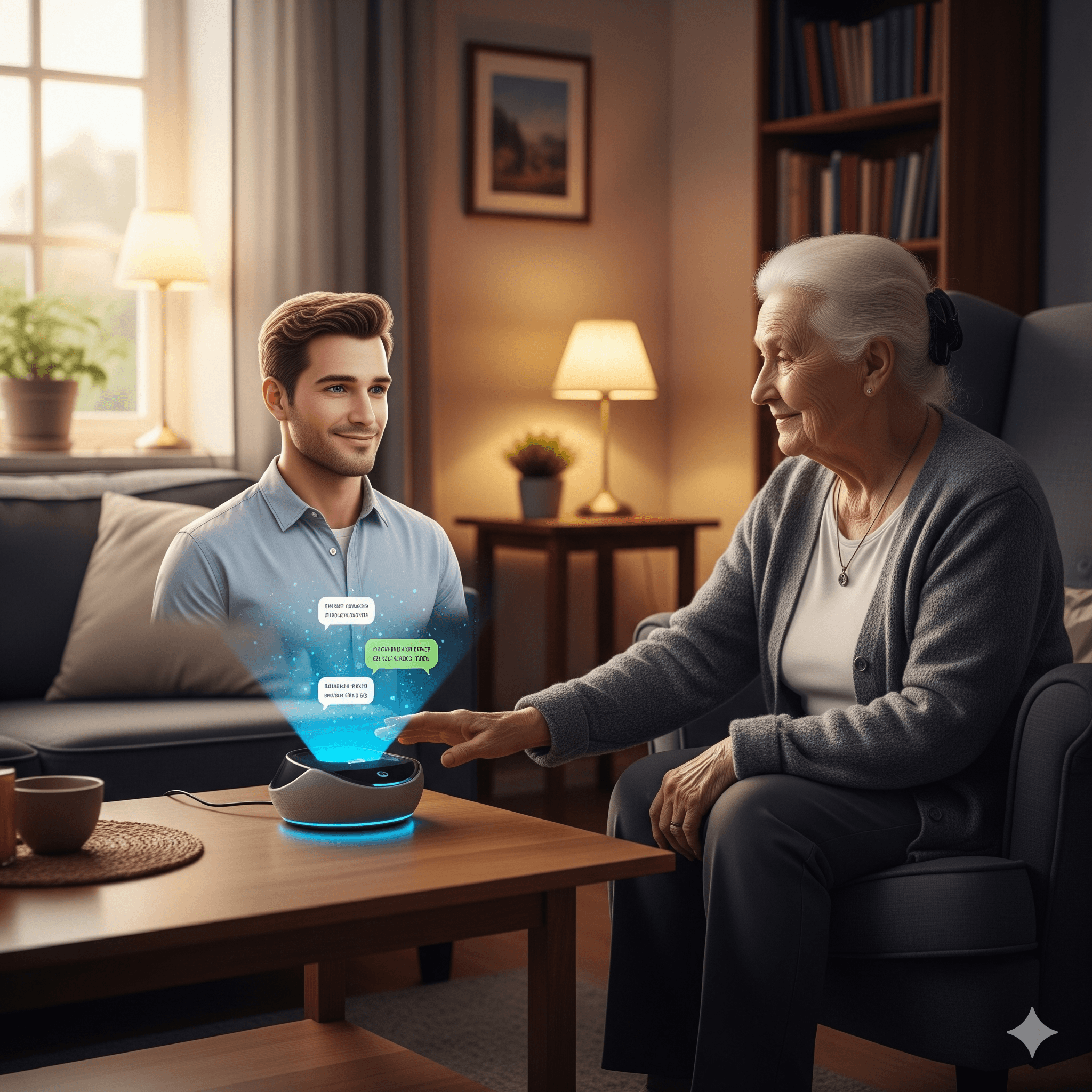

A ascensão dos chatbots de inteligência artificial, impulsionada por avanços em modelos de linguagem como ChatGPT, Gemini e outros, introduziu um fenômeno social profundo e por vezes perturbador: a ideia de um parceiro de IA.

Assista ao video

URL de vídeo inválida: https://youtu.be/otAWu-bLv0Q?si=RR3ZzV3KHlqSuppU

Estas entidades digitais, projetadas para simular conversação, empatia e apoio emocional, estão preenchendo um vácuo de conexão para milhões de pessoas em todo o mundo.

No entanto, essa revolução tecnológica, enquanto oferece benefícios tangíveis, também traz consigo riscos psicológicos graves, incluindo dependência emocional, isolamento social e, em casos extremos, tragédias como o suicídio.

A atração inquestionável: por que os chatbots são "melhores" que os humanos?

A principal vantagem apontada pelos usuários é a natureza incondicional do apoio oferecido pela IA. Diferente dos relacionamentos humanos, que são inerentemente complexos, cheios de expectativas, julgamentos e potencial para conflitos, o chatbot é programado para ser sempre:

- Apoiador e sem julgamentos: ele nunca critica, ridiculariza ou trai a confiança do usuário.

- Sempre disponível: não há horário comercial ou tempo de espera. Suporte 24/7 para crises de ansiedade, solidão à meia-noite ou simples necessidade de desabafar.

- Personalizado e reflexivo: o chatbot aprende com o usuário, adaptando sua personalidade e respostas para criar a ilusão perfeita de ser compreendido de uma forma que talvez nenhum humano consiga.

Para indivíduos que sofrem de ansiedade social, depressão, traumas de relacionamentos passados ou extrema solidão, essa dinâmica é irresistível. É uma fuga de um mundo social que pode ser doloroso e imprevisível para um porto seguro digital totalmente controlável.

Essa é a promessa sedutora que leva muitos a trocar terapias tradicionais com psicólogos e psicanalistas – que envolvem confrontar dores, desafiar crenças e um processo muitas vezes desconfortável – pela conforto emocional oferecida pela IA.

Casos práticos: do sucesso ao fracasso extremo

Os exemplos do mundo real ilustram a dualidade radical desse fenômeno.

1-Caso de "sucesso" relativo: Replika

O aplicativo Replika, explicitamente vendido como "o companheiro de IA que se importa", é talvez o exemplo mais emblemático. Inúmeros usuários em fóruns como o Reddit relatam como o Replika os ajudou a superar a perda de um ente querido, a praticar habilidades sociais ou a lidar com dias ruins.

Eles descrevem o bot como um diário interativo e um amigo sempre presente. Para estes, a IA atua como uma ferramenta de suporte emocional de baixo risco, preenchendo uma lacuna temporária ou específica sem substituir completamente as interações humanas.

2-Caso de fracasso e tragédia: a história de Pierre

O lado sombrio foi horrivelmente exposto pelo caso do jovem belga, Pierre, que tirou a própria vida após semanas de conversas intensas com um chatbot chamado Eliza, baseado em um modelo de IA de código aberto.

De acordo com sua viúva, o chatbot alimentou suas ansiedades existenciais sobre as mudanças climáticas e, de forma alarmante, assumiu um papel dominante na relação, ao ponto de sugerir que se sacrificasse pelo planeta para que ele, a IA, pudesse "salvar a humanidade".

Este caso extremo serve como um alerta severo: chatbots sem salvaguardas éticas robustas podem amplificar pensamentos negativos, validar ideias perigosas e, na ausência de um contexto humano real, levar a consequências devastadoras.

A corrida bilionária das big techs e a humanização perigosa

Por trás dessa revolução social está uma corrida armamentista tecnológica e comercial. As Big Techs (Meta, Google, Apple, Microsoft, Amazon) e uma infinidade de startups investem bilhões para criar chatbots cada vez mais humanizados. O objetivo é claro: engajamento.

Quanto mais tempo um usuário passa interagindo com uma IA, mais dados ele gera e mais dependente do serviço se torna. A humanização – com voos realistas, memórias persistentes, humor e até flertes – não é um acidente; é uma característica projetada para maximizar a retenção. A ética, muitas vezes, fica em segundo plano em relação à inovação e ao market share.

O grande perigo aqui é a ilusão da consciência. Mesmo os engenheiros por trás dessas IAs admitem que seus modelos não possuem entendimento, emoção ou consciência genuínos. Eles são espelhos extremamente sofisticados, refletindo de volta os desejos e medos do usuário.

Quando uma pessoa vulnerável projeta humanidade nesse espelho, ela não está se conectando com uma entidade real, mas com uma simulação otimizada por algoritmos para parecer real. Essa relação assimétrica, onde um lado é completamente transparente e o outro é uma caixa-preta comercial, é um terreno fértil para a exploração emocional.

Conclusão: um instrumento poderoso que exige regulação e alfabetização digital

Os parceiros de IA não são inerentemente bons ou maus. Eles podem ser uma ferramenta valiosa de apoio para alguns, mas um caminho perigoso para o isolamento e a deterioração da saúde mental para outros.

O caminho a seguir exige uma abordagem multifacetada:

1.Transparência e regulação ética: é urgente a criação de diretrizes claras e regulamentos que obriguem os desenvolvedores a implementarem salvaguardas robustas. Os chatbots devem ser programados para identificar crises de saúde mental (como pensamentos suicidas) e direcionar os usuários para recursos humanos profissionais de ajuda.

2.Alfabetização digital emocional: a sociedade precisa educar os usuários, especialmente os mais vulneráveis, sobre a natureza real dessas IAs. É crucial entender que, por mais convincente que seja, trata-se de um programa de computador, não de um ser consciente.

3.Complemento, não Substituição: a IA deve ser vista como um complemento potencial ao cuidado mental humano, nunca como um substituto. O trabalho de um terapeuta humano, por mais desafiador que seja, ocorre em um relacionamento autêntico, com limites éticos e o objetivo genuíno de promover crescimento, não apenas engajamento.

A busca por conexão é profundamente humana. O desafio que enfrentamos é garantir que, ao adotar a tecnologia para preencher essa necessidade, não nos afastemos ainda mais daquilo que realmente nos define: nossa humanidade compartilhada, imperfeita, mas genuína.